Python中XML和XPATH指的是什么-創(chuàng)新互聯(lián)

創(chuàng)新互聯(lián)www.cdcxhl.cn八線動態(tài)BGP香港云服務(wù)器提供商,新人活動買多久送多久,劃算不套路!

這篇文章將為大家詳細(xì)講解有關(guān)Python中XML和XPATH指的是什么,小編覺得挺實(shí)用的,因此分享給大家做個參考,希望大家閱讀完這篇文章后可以有所收獲。

XML和XPATH

用正則處理HTML文檔很麻煩,我們可以先將HTML文件轉(zhuǎn)換成XML文檔,然后用XPath查找HTML節(jié)點(diǎn)或元素。

XML 指可擴(kuò)展標(biāo)記語言(EXtensible Markup Language)

XML 是一種標(biāo)記語言,很類似 HTML

XML 的設(shè)計(jì)宗旨是傳輸數(shù)據(jù),而非顯示數(shù)據(jù)

XML 的標(biāo)簽需要我們自行定義。

XML 被設(shè)計(jì)為具有自我描述性。

XML 是 W3C 的推薦標(biāo)準(zhǔn)

XML和HTML區(qū)別

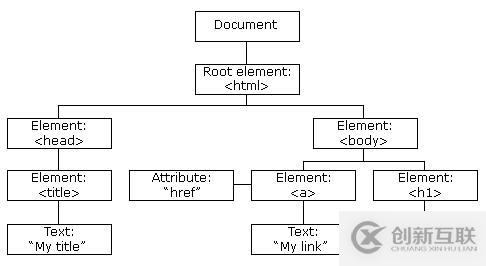

HTML DOM 模型示例

HTML DOM 定義了訪問和操作 HTML 文檔的標(biāo)準(zhǔn)方法,以樹結(jié)構(gòu)方式表達(dá) HTML 文檔。

XPATH

XPath (XML Path Language) 是一門在XML文檔中查找信息的語言,可用來在 XML 文檔中對元素和屬性進(jìn)行遍歷。

chrome插件XPATH HelPer

Firefox插件XPATH Checker

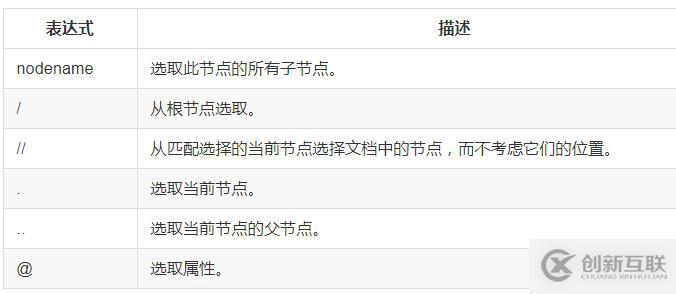

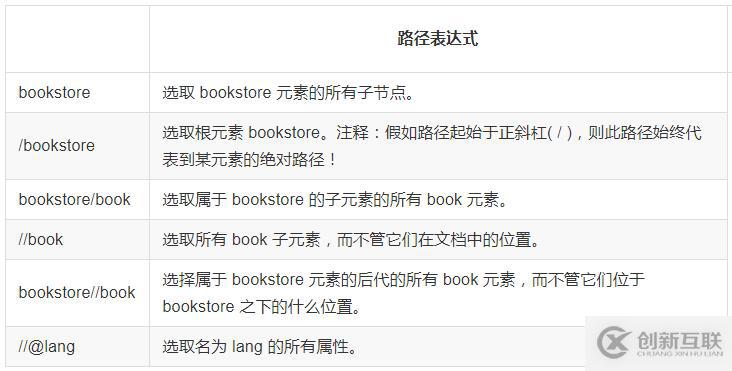

XPATH語法

最常用的路徑表達(dá)式:

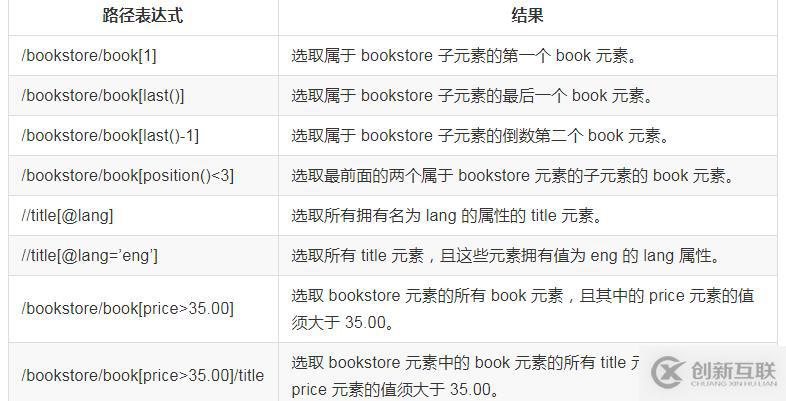

謂語

謂語用來查找某個特定的節(jié)點(diǎn)或者包含某個指定的值的節(jié)點(diǎn),被嵌在方括號中。

在下面的表格中,我們列出了帶有謂語的一些路徑表達(dá)式,以及表達(dá)式的結(jié)果:

選取位置節(jié)點(diǎn)

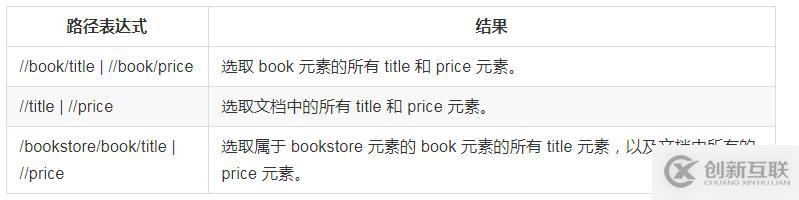

選取若干路徑

LXML庫

安裝:pip install lxml

lxml 是 一個HTML/XML的解析器,主要的功能是如何解析和提取 HTML/XML 數(shù)據(jù)。

lxml和正則一樣,也是用 C 實(shí)現(xiàn)的,是一款高性能的 Python HTML/XML 解析器,可以利用XPath語法,來快速的定位特定元素以及節(jié)點(diǎn)信息。

簡單使用方法

#!/usr/bin/env python # -*- coding:utf-8 -*- from lxml import etree text = ''' <div> <li>11</li> <li>22</li> <li>33</li> <li>44</li> </div> ''' #利用etree.HTML,將字符串解析為HTML文檔 html = etree.HTML(text) # 按字符串序列化HTML文檔 result = etree.tostring(html) print(result)

結(jié)果:

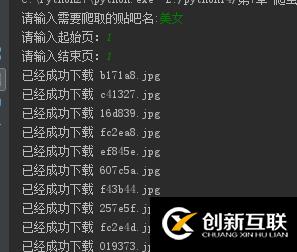

爬取美女吧圖片

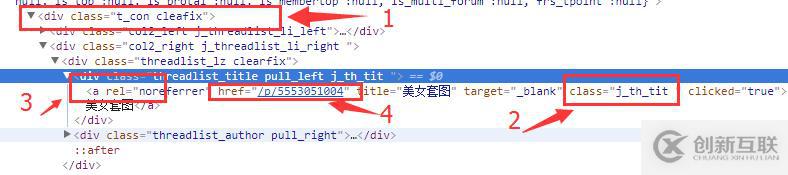

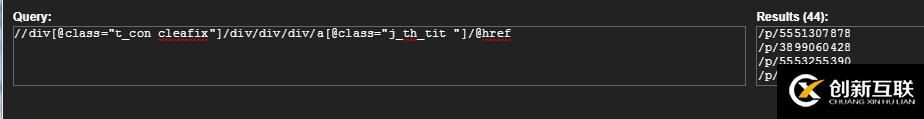

1.先找到每個帖子列表的url集合

2.再找到每個帖子里面的每個圖片的的完整url鏈接

3.要用到 lxml 模塊去解析html

#!/usr/bin/env python

# -*- coding:utf-8 -*-

import urllib

import urllib2

from lxml import etree

def loadPage(url):

"""

作用:根據(jù)url發(fā)送請求,獲取服務(wù)器響應(yīng)文件

url: 需要爬取的url地址

"""

request = urllib2.Request(url)

html = urllib2.urlopen(request).read()

# 解析HTML文檔為HTML DOM模型

content = etree.HTML(html)

# 返回所有匹配成功的列表集合

link_list = content.xpath('//div[@class="t_con cleafix"]/div/div/div/a/@href')

for link in link_list:

fulllink = "http://tieba.baidu.com" + link

# 組合為每個帖子的鏈接

#print link

loadImage(fulllink)

# 取出每個帖子里的每個圖片連接

def loadImage(link):

headers = {

'User-Agent': 'Mozilla/5.0 (Windows NT 6.1; Win64; x64) AppleWebKit/537.36 (KHTML, like Gecko)

Chrome/60.0.3112.101 Safari/537.36'}

request = urllib2.Request(link, headers = headers)

html = urllib2.urlopen(request).read()

# 解析

content = etree.HTML(html)

# 取出帖子里每層層主發(fā)送的圖片連接集合

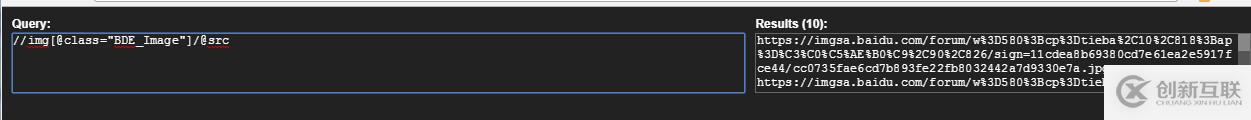

link_list = content.xpath('//img[@class="BDE_Image"]/@src')

# 取出每個圖片的連接

for link in link_list:

# print link

writeImage(link)

def writeImage(link):

"""

作用:將html內(nèi)容寫入到本地

link:圖片連接

"""

#print "正在保存 " + filename

headers = {"User-Agent" : "Mozilla/5.0 (Windows NT 10.0; Win64; x64) AppleWebKit/537.36 (KHTML, like Gecko)

Chrome/54.0.2840.99 Safari/537.36"}

# 文件寫入

request = urllib2.Request(link, headers = headers)

# 圖片原始數(shù)據(jù)

image = urllib2.urlopen(request).read()

# 取出連接后10位做為文件名

filename = link[-10:]

# 寫入到本地磁盤文件內(nèi)

with open(filename, "wb") as f:

f.write(image)

print "已經(jīng)成功下載 "+ filename

def tiebaSpider(url, beginPage, endPage):

"""

作用:貼吧爬蟲調(diào)度器,負(fù)責(zé)組合處理每個頁面的url

url : 貼吧url的前部分

beginPage : 起始頁

endPage : 結(jié)束頁

"""

for page in range(beginPage, endPage + 1):

pn = (page - 1) * 50

#filename = "第" + str(page) + "頁.html"

fullurl = url + "&pn=" + str(pn)

#print fullurl

loadPage(fullurl)

#print html

print "謝謝使用"

if __name__ == "__main__":

kw = raw_input("請輸入需要爬取的貼吧名:")

beginPage = int(raw_input("請輸入起始頁:"))

endPage = int(raw_input("請輸入結(jié)束頁:"))

url = "http://tieba.baidu.com/f?"

key = urllib.urlencode({"kw": kw})

fullurl = url + key

tiebaSpider(fullurl, beginPage, endPage)4.爬取的圖片全部保存到了電腦里面

關(guān)于Python中XML和XPATH指的是什么就分享到這里了,希望以上內(nèi)容可以對大家有一定的幫助,可以學(xué)到更多知識。如果覺得文章不錯,可以把它分享出去讓更多的人看到。

分享文章:Python中XML和XPATH指的是什么-創(chuàng)新互聯(lián)

標(biāo)題來源:http://chinadenli.net/article22/ddpscc.html

成都網(wǎng)站建設(shè)公司_創(chuàng)新互聯(lián),為您提供做網(wǎng)站、網(wǎng)站內(nèi)鏈、搜索引擎優(yōu)化、網(wǎng)站導(dǎo)航、自適應(yīng)網(wǎng)站、動態(tài)網(wǎng)站

聲明:本網(wǎng)站發(fā)布的內(nèi)容(圖片、視頻和文字)以用戶投稿、用戶轉(zhuǎn)載內(nèi)容為主,如果涉及侵權(quán)請盡快告知,我們將會在第一時間刪除。文章觀點(diǎn)不代表本網(wǎng)站立場,如需處理請聯(lián)系客服。電話:028-86922220;郵箱:631063699@qq.com。內(nèi)容未經(jīng)允許不得轉(zhuǎn)載,或轉(zhuǎn)載時需注明來源: 創(chuàng)新互聯(lián)

- b2c網(wǎng)站策劃方案 2022-06-06

- 網(wǎng)站策劃之網(wǎng)站項(xiàng)目的實(shí)施計(jì)劃(二) 2016-11-05

- 再談2016年網(wǎng)站策劃 2016-11-02

- 網(wǎng)站策劃方案非常重要 2016-11-06

- 建網(wǎng)站:營銷型網(wǎng)站策劃的重要性 2023-03-05

- 網(wǎng)站維護(hù)包括網(wǎng)站策劃、網(wǎng)頁設(shè)計(jì)、網(wǎng)站推廣等內(nèi)容 2022-08-13

- 網(wǎng)站建設(shè)前期的網(wǎng)站策劃要怎么進(jìn)行? 2022-08-31

- 基礎(chǔ)性的網(wǎng)站策劃原則 2016-11-03

- 網(wǎng)站策劃——網(wǎng)站建設(shè)的靈魂 2022-12-01

- 網(wǎng)站策劃會和你討論的幾個關(guān)鍵點(diǎn) 2016-09-10

- 建站前的網(wǎng)站策劃是多么重要! 2016-08-12

- 上海網(wǎng)站設(shè)計(jì)需要做好網(wǎng)站策劃 2020-11-11