怎樣定義TensorFlow輸入節(jié)點-創(chuàng)新互聯(lián)

這篇文章主要介紹了怎樣定義TensorFlow輸入節(jié)點,具有一定借鑒價值,感興趣的朋友可以參考下,希望大家閱讀完這篇文章之后大有收獲,下面讓小編帶著大家一起了解一下。

創(chuàng)新互聯(lián)長期為上1000+客戶提供的網(wǎng)站建設服務,團隊從業(yè)經(jīng)驗10年,關注不同地域、不同群體,并針對不同對象提供差異化的產(chǎn)品和服務;打造開放共贏平臺,與合作伙伴共同營造健康的互聯(lián)網(wǎng)生態(tài)環(huán)境。為賈汪企業(yè)提供專業(yè)的成都網(wǎng)站制作、成都做網(wǎng)站,賈汪網(wǎng)站改版等技術服務。擁有十多年豐富建站經(jīng)驗和眾多成功案例,為您定制開發(fā)。TensorFlow中有如下幾種定義輸入節(jié)點的方法。

通過占位符定義:一般使用這種方式。

通過字典類型定義:一般用于輸入比較多的情況。

直接定義:一般很少使用。

一 占位符定義

示例:

具體使用tf.placeholder函數(shù),代碼如下:

X = tf.placeholder("float")

Y = tf.placeholder("float")二 字典類型定義

1 實例

通過字典類型定義輸入節(jié)點

2 關鍵代碼

# 創(chuàng)建模型

# 占位符

inputdict = {

'x': tf.placeholder("float"),

'y': tf.placeholder("float")

}3 解釋

通過字典定義的方式和第一種比較像,只不過是堆疊到一起。

4 全部代碼

import tensorflow as tf

import numpy as np

import matplotlib.pyplot as plt

plotdata = { "batchsize":[], "loss":[] }

def moving_average(a, w=10):

if len(a) < w:

return a[:]

return [val if idx < w else sum(a[(idx-w):idx])/w for idx, val in enumerate(a)]

#生成模擬數(shù)據(jù)

train_X = np.linspace(-1, 1, 100)

train_Y = 2 * train_X + np.random.randn(*train_X.shape) * 0.3 # y=2x,但是加入了噪聲

#圖形顯示

plt.plot(train_X, train_Y, 'ro', label='Original data')

plt.legend()

plt.show()

# 創(chuàng)建模型

# 占位符

inputdict = {

'x': tf.placeholder("float"),

'y': tf.placeholder("float")

}

# 模型參數(shù)

W = tf.Variable(tf.random_normal([1]), name="weight")

b = tf.Variable(tf.zeros([1]), name="bias")

# 前向結構

z = tf.multiply(inputdict['x'], W)+ b

#反向優(yōu)化

cost =tf.reduce_mean( tf.square(inputdict['y'] - z))

learning_rate = 0.01

optimizer = tf.train.GradientDescentOptimizer(learning_rate).minimize(cost) #Gradient descent

# 初始化變量

init = tf.global_variables_initializer()

#參數(shù)設置

training_epochs = 20

display_step = 2

# 啟動session

with tf.Session() as sess:

sess.run(init)

# Fit all training data

for epoch in range(training_epochs):

for (x, y) in zip(train_X, train_Y):

sess.run(optimizer, feed_dict={inputdict['x']: x, inputdict['y']: y})

#顯示訓練中的詳細信息

if epoch % display_step == 0:

loss = sess.run(cost, feed_dict={inputdict['x']: train_X, inputdict['y']:train_Y})

print ("Epoch:", epoch+1, "cost=", loss,"W=", sess.run(W), "b=", sess.run(b))

if not (loss == "NA" ):

plotdata["batchsize"].append(epoch)

plotdata["loss"].append(loss)

print (" Finished!")

print ("cost=", sess.run(cost, feed_dict={inputdict['x']: train_X, inputdict['y']: train_Y}), "W=", sess.run(W), "b=", sess.run(b))

#圖形顯示

plt.plot(train_X, train_Y, 'ro', label='Original data')

plt.plot(train_X, sess.run(W) * train_X + sess.run(b), label='Fitted line')

plt.legend()

plt.show()

plotdata["avgloss"] = moving_average(plotdata["loss"])

plt.figure(1)

plt.subplot(211)

plt.plot(plotdata["batchsize"], plotdata["avgloss"], 'b--')

plt.xlabel('Minibatch number')

plt.ylabel('Loss')

plt.title('Minibatch run vs. Training loss')

plt.show()

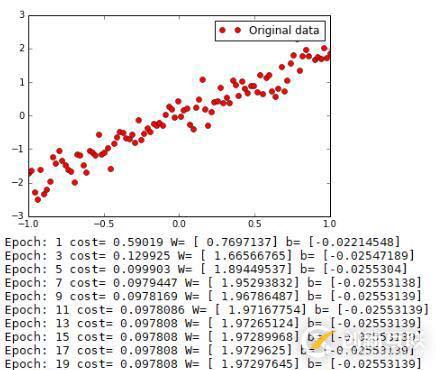

print ("x=0.2,z=", sess.run(z, feed_dict={inputdict['x']: 0.2}))5 運行結果

三 直接定義

1 實例

直接定義輸入結果

2 解釋

直接定義:將定義好的Python變量直接放到OP節(jié)點中參與輸入的運算,將模擬數(shù)據(jù)的變量直接放到模型中訓練。

3 代碼

import tensorflow as tf

import numpy as np

import matplotlib.pyplot as plt

#生成模擬數(shù)據(jù)

train_X =np.float32( np.linspace(-1, 1, 100))

train_Y = 2 * train_X + np.random.randn(*train_X.shape) * 0.3 # y=2x,但是加入了噪聲

#圖形顯示

plt.plot(train_X, train_Y, 'ro', label='Original data')

plt.legend()

plt.show()

# 創(chuàng)建模型

# 模型參數(shù)

W = tf.Variable(tf.random_normal([1]), name="weight")

b = tf.Variable(tf.zeros([1]), name="bias")

# 前向結構

z = tf.multiply(W, train_X)+ b

#反向優(yōu)化

cost =tf.reduce_mean( tf.square(train_Y - z))

learning_rate = 0.01

optimizer = tf.train.GradientDescentOptimizer(learning_rate).minimize(cost) #Gradient descent

# 初始化變量

init = tf.global_variables_initializer()

#參數(shù)設置

training_epochs = 20

display_step = 2

# 啟動session

with tf.Session() as sess:

sess.run(init)

# Fit all training data

for epoch in range(training_epochs):

for (x, y) in zip(train_X, train_Y):

sess.run(optimizer)

#顯示訓練中的詳細信息

if epoch % display_step == 0:

loss = sess.run(cost)

print ("Epoch:", epoch+1, "cost=", loss,"W=", sess.run(W), "b=", sess.run(b))

print (" Finished!")

print ("cost=", sess.run(cost), "W=", sess.run(W), "b=", sess.run(b))4 運行結果

感謝你能夠認真閱讀完這篇文章,希望小編分享的“怎樣定義TensorFlow輸入節(jié)點”這篇文章對大家有幫助,同時也希望大家多多支持創(chuàng)新互聯(lián),關注創(chuàng)新互聯(lián)行業(yè)資訊頻道,更多相關知識等著你來學習!

網(wǎng)頁標題:怎樣定義TensorFlow輸入節(jié)點-創(chuàng)新互聯(lián)

文章地址:http://chinadenli.net/article20/cedjco.html

成都網(wǎng)站建設公司_創(chuàng)新互聯(lián),為您提供Google、手機網(wǎng)站建設、企業(yè)建站、品牌網(wǎng)站建設、標簽優(yōu)化、全網(wǎng)營銷推廣

聲明:本網(wǎng)站發(fā)布的內(nèi)容(圖片、視頻和文字)以用戶投稿、用戶轉載內(nèi)容為主,如果涉及侵權請盡快告知,我們將會在第一時間刪除。文章觀點不代表本網(wǎng)站立場,如需處理請聯(lián)系客服。電話:028-86922220;郵箱:631063699@qq.com。內(nèi)容未經(jīng)允許不得轉載,或轉載時需注明來源: 創(chuàng)新互聯(lián)

猜你還喜歡下面的內(nèi)容

- 服務器托管收費標準 2021-03-20

- 你真的了解服務器托管收費標準嗎? 2021-03-16

- 服務器托管時怎么判斷是否死機 2022-10-03

- 服務器托管和服務器租用是一樣的嗎?有什么區(qū)別? 2022-10-08

- 什么是服務器?服務器托管與租用有什么不同? 2022-10-03

- 香港服務器托管和租用服務器有什么區(qū)別?網(wǎng)站訪問速度慢的原因是什么? 2022-10-04

- 美國高防服務器托管價格是多少? 2022-10-12

- 為什么要進idc數(shù)據(jù)中心服務器機房托管? 2015-03-10

- 服務器托管帶寬選擇有什么依據(jù)? 2022-10-08

- 服務器托管硬件配置如何選擇? 2022-10-02

- 北京雙線服務器托管哪家好? 2021-03-18

- 服務器托管與租用的區(qū)別 2021-03-01